| Generative Pre-trained Transformer 3 (GPT-3) software | |

|---|---|

| |

| Genere | Intelligenza artificiale (non in lista) |

| Sviluppatore | OpenAI |

| Data prima versione | 28 maggio 2020 |

| Ultima versione | 175B |

| Sistema operativo | Cloud Computing (non in lista) |

| Licenza | licenza proprietaria (licenza non libera) |

| Sito web | github.com/openai/gpt-3 |

Generative Pre-trained Transformer 3 (GPT·3) è un modello linguistico di grandi dimensioni autoregressivo che utilizza l'apprendimento profondo per produrre testo simile al linguaggio naturale umano. "Si tratta di un algoritmo di Natural Language Generation, un settore della linguistica computazionale focalizzato sulla generazione automatica di espressioni linguistiche che siano morfologicamente, sintatticamente e semanticamente corrette e il più possibile simili all’uso umano della lingua".[1]

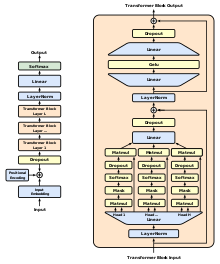

Come il precedente GPT-2, l'architettura si basa su un modello di trasformatore con 175 miliardi di parametri, che richiedono 800 GB di memoria per l'esecuzione. Il metodo di apprendimento è detto "pre-addestramento generativo", e ha lo scopo di fornire al sistema la capacità di prevedere quale sarà la prossima parola nell'ambito di una frase o di un insieme di frasi. Il modello ha dimostrato un apprendimento rapido su molte attività basate su testo.

È il modello di terza generazione della serie GPT creato da OpenAI, un laboratorio di ricerca sull'intelligenza artificiale con sede a San Francisco.[2] La versione completa di GPT-3 ha una capacità di 175 miliardi di parametri di apprendimento automatico. GPT-3, introdotto a maggio 2020 [3], segue il trend dei sistemi di elaborazione del linguaggio naturale (NLP) delle rappresentazioni linguistiche pre-addestrate.

La qualità del testo generato da GPT-3 è talmente alta che può essere difficile determinare se è stato scritto o meno da un essere umano, il che presenta sia vantaggi che rischi.[4] Trentuno ricercatori e ingegneri di OpenAI hanno presentato il documento originale che introduceva GPT-3 il 28 maggio 2020. Nell'articolo hanno avvertito dei potenziali pericoli di GPT-3 e hanno suggerito ulteriori ricerche per analizzare e mitigare il rischio. Il filosofo australiano David Chalmers ha descritto GPT-3 come "uno dei più interessanti e importanti sistemi di intelligenza artificiale mai prodotti".[5]

Microsoft ha annunciato il 22 settembre 2020 di avere in licenza l'uso "esclusivo" di GPT-3; altri enti o utilizzatori finali possono ancora utilizzare le API (Application Programming Interface) pubbliche per ricevere l'output, ma solo Microsoft ha accesso al modello sottostante di GPT-3.[6]

La versione GPT-3.5 è alla base di ChatGPT, il modello linguistico di grandi dimensioni di OpenAI, che ha raggiunto capacità sorprendenti. Dalla data del suo rilascio il 3 novembre 2022 a febbraio 2023, ha visto crescere la sua popolarità in tutto il mondo, raggiungendo velocemente i 100 milioni di utenti. ChatGPT avrà un impatto enorme nella diffusione, nell'uso e nella comprensione dell'intelligenza artificiale in tantissimi domini della società, dell'economia e della cultura umana.

Una recensione del New York Times dell'aprile 2022 ha descritto alcune capacità di GPT-3, come scrivere una prosa originale con una fluidità equivalente a quella di un essere umano.[7]

Altri modelli di intelligenza artificiale utilizzano versioni modificate di GPT-3 per generare immagini partendo da un frase in lingua inglese, in particolare DALL-E, DALL-E 2 e DALL-E 3.

Il 14 marzo 2023 OpenAI ha annunciato il rilascio della quarta generazione del modello, GPT-4, che accetta input di immagini e testo, producendo output di testo. GPT-4 mostra prestazioni a livello umano su vari benchmark professionali e accademici, sebbene sia meno capace degli uomini in molti scenari del mondo reale.

- ^ GPT-3 eguaglia l'intelligenza umana, su proversi.it.

- ^ https://www.cnbc.com/2020/07/23/openai-gpt3-explainer.html. Four preprints were released between May 28 and July 22, 2020.

- ^ towardsdatascience.com, https://towardsdatascience.com/will-gpt-3-kill-coding-630e4518c04d. URL consultato il 1º agosto 2020.

- ^ Ram Sagar, OpenAI Releases GPT-3, The Largest Model So Far, in Analytics India Magazine, 3 giugno 2020. URL consultato il 31 luglio 2020.

- ^ https://dailynous.com/2020/07/30/philosophers-gpt-3/#chalmers.

- ^ (EN) Karen Hao, OpenAI is giving Microsoft exclusive access to its GPT-3 language model, in MIT Technology Review, 23 settembre 2020. URL consultato il 25 settembre 2020.«"The companies say OpenAI will continue to offer its public-facing API, which allows chosen users to send text to GPT-3 or OpenAI's other models and receive its output. Only Microsoft, however, will have access to GPT-3's underlying code, allowing it to embed, repurpose, and modify the model as it pleases."»

- ^ The New York Times, https://www.nytimes.com/2022/04/15/magazine/ai-language.html.